Ich habe viel über Rag- und AI-Agenten gelesen, aber mit der Ver?ffentlichung neuer Modelle wie Deepseek V3 und Deepseek R1 scheint es, dass die M?glichkeit, effiziente Rag-Systeme zu bauen, erheblich verbessert hat, eine bessere Abrufgenauigkeit, eine verbesserte Argumentationsfunktionen und die skalierbaren Architekturen für reale Anwendungen bietet. Die Integration von ausgefeilteren Abrufmechanismen, verbesserten Feinabstimmungsoptionen und multimodalen Funktionen ver?ndern die Art und Weise, wie KI-Agenten mit Daten interagieren. Es wirft Fragen darauf auf, ob traditionelle Lag -Ans?tze immer noch der beste Weg sind oder ob neuere Architekturen effizientere und kontextbezogene L?sungen liefern k?nnen.

Abruf-general-aus-Generation (RAG) -Systeme haben die Art und Weise revolutioniert, wie AI-Modelle mit Daten interagieren, indem abrufbasierte und generative Ans?tze kombiniert werden, um genauere und kontextbezogene Antworten zu erzielen. Mit dem Aufkommen von Deepseek R1 ist ein Open-Source-Modell, das für seine Effizienz und Kosteneffizienz bekannt ist, ein effektives Lappensystem zug?nglicher und praktischer geworden. In diesem Artikel bauen wir ein Lappensystem mit Deepseek R1.

Inhaltsverzeichnis- Was ist Deepseek R1? Was ist Deepseek R1?

- Deepseek R1 ist ein Open-Source-AI-Modell, das entwickelt wurde und das Ziel ist, qualitativ hochwertige Argumentations- und Abruffunktionen zu einem Bruchteil der Kosten für propriet?re Modelle wie OpenAIs Angebote bereitzustellen. Es verfügt über eine MIT -Lizenz, wodurch es kommerziell rentabel und für eine Vielzahl von Anwendungen geeignet ist. Mit diesem leistungsstarken Modell k?nnen Sie das Kinderbett sehen, aber die OpenAI O1 und O1-Mini zeigen kein Argumentations-Token.?

- , um zu wissen, wie Deepseek R1 das OpenAI O1 -Modell herausfordert: Deepseek R1 gegen OpenAI O1: Welches ist schneller, billiger und schlauer??

Vorteile der Verwendung von Deepseek R1 für RAG -System Aufbau eines RAG-Systems (Retrieval-Augmented Generation) mit Deepseek-R1 bietet mehrere bemerkenswerte Vorteile:

1. Fortgeschrittene Argumentationsfunktionen : Deepseek-R1 emuliert das menschliche Argumentation durch Analyse und Verarbeitung von Informationen Schritt für Schritt, bevor Sie Schlussfolgerungen ziehen. Dieser Ansatz verbessert die F?higkeit des Systems, komplexe Abfragen zu bew?ltigen, insbesondere in Bereichen, die logische Inferenz, mathematisches Denken und Codierungsaufgaben erfordern.

2. Open-Source-Barrierefreiheit: Deepseek-R1 wurde unter der MIT-Lizenz ver?ffentlicht und erm?glicht den uneingeschr?nkten Zugang zu seinem Modell. Diese Offenheit erleichtert die Anpassung, Feinabstimmung und Integration in verschiedene Anwendungen ohne die h?ufig mit propriet?ren Modellen verbundenen Einschr?nkungen.

3. Wettbewerbsleistung : Benchmark-Tests zeigen, dass Deepseek-R1 in Aufgaben, die Argumentation, Mathematik und Codierung beinhalten, mit dem O1-O1 von OpenAI und sogar übertrifft oder sogar übertrifft. Diese Leistungsstufe stellt sicher, dass ein mit Deepseek-R1 erstellter Lappensystem qualitativ hochwertige, genaue Reaktionen für verschiedene und herausfordernde Fragen liefern kann.

4. Transparenz im Denkprozess : Deepseek-r1 verwendet eine ?Kette der Gedanken“, wodurch seine Argumentationsschritte w?hrend der Inferenz sichtbar sind. Diese Transparenz hilft beim Debuggen und Verfeinern des Systems gleichzeitig das Aufbau von Benutzervertrauen durch klare Einblicke in den Entscheidungsprozess.

5. Kosteneffizienz : Die Open-Source-Natur von Deepseek-R1 beseitigt Lizenzgebühren, und seine effiziente Architektur verringert die Anforderungen an die Rechenressourcen. Diese Faktoren tragen zu einer kostengünstigeren L?sung für Organisationen bei, die anspruchsvolle Lag-Systeme implementieren m?chten, ohne erhebliche Ausgaben zu erfüllen.

Integration von Deepseek-R1 in ein Lag-System bietet eine wirksame Kombination aus fortschrittlichen Argumentationsf?higkeiten, Transparenz, Leistung und Kosteneffizienz, was es zu einer überzeugenden Wahl für Entwickler und Organisationen macht, die ihre KI-Funktionen verbessern m?chten.

Schritte zum Erstellen eines Lappensystems mit Deepseek R1

Das Skript ist eine RAG-Pipeline (Abrufen-ausgerastete Generation (RAG), die:

- l?dt und verarbeitet ein PDF -Dokument , indem es in Seiten aufteilt und Text extrahiert wird.

- speichert vektorisierte Darstellungen des Textes in einer Datenbank (Chromadb).

- ruft relevante Inhalte mit ?hnlichkeitssuche ab, wenn eine Abfrage gefragt wird.

- verwendet ein LLM (Deepseek -Modell) , um Antworten basierend auf dem abgerufenen Text zu generieren.

Voraussetzungen installieren

- Download olama: Klicken Sie hier, um herunterzuladen

- Für Linux -Benutzer: Führen Sie den folgenden Befehl in Ihrem Terminal aus:

curl -fsSL https://ollama.com/install.sh | sh

Danach ziehen Sie den Deepseek R1: 1,5B mit:

ollama pull deepseek-r1:1.5b

Dies dauert einen Moment, um herunterzuladen:

ollama pull deepseek-r1:1.5b pulling manifest pulling aabd4debf0c8... 100% ▕████████████████▏ 1.1 GB pulling 369ca498f347... 100% ▕████████████████▏ 387 B pulling 6e4c38e1172f... 100% ▕████████████████▏ 1.1 KB pulling f4d24e9138dd... 100% ▕████████████████▏ 148 B pulling a85fe2a2e58e... 100% ▕████████████████▏ 487 B verifying sha256 digest writing manifest success

?ffnen Sie danach Ihr Jupyter -Notizbuch und beginnen Sie mit dem Codierungsteil:

1. Installieren Sie Abh?ngigkeiten

Vor dem Ausführen installiert das Skript die erforderlichen Python -Bibliotheken:

- Langchain → Ein Framework zum Erstellen von Anwendungen mit gro?er Sprachmodellen (LLMs).

- Langchain-OpenAI → Bietet Integration mit OpenAI-Diensten.

- Langchain-Community → Fügt Unterstützung für verschiedene Dokumentenlader und Dienstprogramme hinzu.

- Langchain-Chroma → Erm?glicht die Integration mit Chromadb, einer Vektor-Datenbank.

2. Geben Sie den OpenAI -API -Schlüssel

einUm auf das Einbettungsmodell von OpenAI zuzugreifen, fordert das Skript den Benutzer auf, die API -Schlüssel mit GetPass () sicher einzugeben. Dies verhindert, dass Anmeldeinformationen im Klartext aufgedeckt werden.

3. Umgebungsvariablen einrichtenDas Skript

speichert den API -Schlüssel als Umgebungsvariable. Auf diese Weise k?nnen andere Teile des Codes auf OpenAI Services ohne harte Anmeldeinformationen zugreifen, was die Sicherheit verbessert.

4. OpenAI -Einbettunginitialisieren

Das Skript initialisiert ein OpenAI-Einbettungsmodell mit dem Namen "Text-Embedding-3-Small". Dieses Modellwandelt Text in Vektor-Einbettung um, bei denen hochwertige numerische Darstellungen der Bedeutung des Textes sind. Diese Einbettungen werden sp?ter verwendet, um ?hnliche Inhalte zu vergleichen und abzurufen. 5. Laden und teilen Sie ein PDF -Dokument

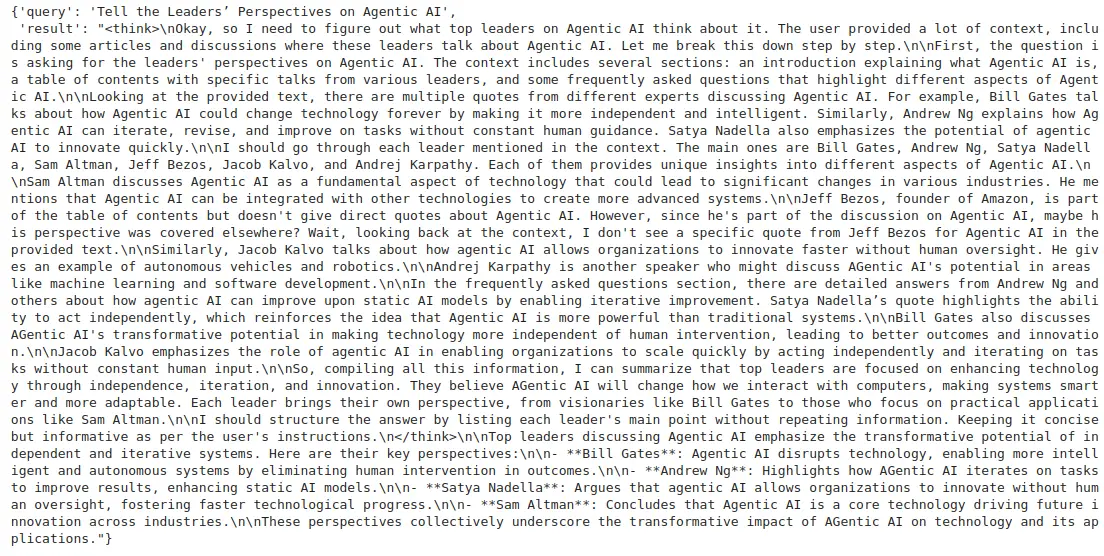

aufEine PDF -Datei (agenticai.pdf) wird

geladen und in Seitenaufgeteilt. Jeder Seitentext wird extrahiert, wodurch kleinere und überschaubarere Textbrocken anstatt das gesamte Dokument als einzelne Einheit zu verarbeiten. .

6. Erstellen und speichern Sie eine Vektordatenbank- Der extrahierte Text aus dem PDF wird

- in Vektor -Emettdings . konvertiert Diese Einbettungen werden

- in Chromadb , einer Hochleistungsdatenbank Vektor, gespeichert. . Die Datenbank verwendet

- Cosinus -?hnlichkeit , um ein effizientes Abrufen des Textes mit einem hohen Grad an semantischer ?hnlichkeit zu gew?hrleisten.

ab

aretriever wird unter Verwendung von Chromadb erstellt, was:

- sucht nach den Top 3 ?hnlichsten Dokumente basierend auf einer bestimmten Abfrage. filtert Ergebnisse basierend auf einem ?hnlichkeitsschwellenwert von 0,3, was bedeutet, dass Dokumente mindestens 30% ?hnlichkeit haben müssen, um als relevant zu qualifizieren.

Es werden zwei Testabfragen verwendet:

- "Was ist die alte Hauptstadt Indiens?"

-

- Es wurden keine Ergebnisse gefunden , was darauf hinweist, dass die gespeicherten Dokumente keine relevanten Informationen enthalten.

"Was ist Agentic Ai?"

-

- ruft den relevanten Text erfolgreich ab und zeigt, dass das System einen sinnvollen Kontext holen kann.

Das Skript legt eine

RAG -Pipeline fest, die sicherstellt, dass: Anstelle von OpenAIs GPT l?dt das Skript Deepseek-R1 (1,5B-Parameter) , ein leistungsstarkes LLM, das für retrievale Aufgaben optimiert ist. Langchains retrievales Modul wird verwendet, um: Das Skript führt eine Testabfrage aus:

Das llm erzeugt eine faktenbasierte Antwort

Das System ruft relevante Informationen aus der Datenbank

Langchain -Syntax für die Lappenkette

Schlussfolgerung

M?chten Sie Anwendungen mit Deepseek erstellen? Kasse unseren kostenlosen Deepseek -Kurs heute!

10. Laden Sie eine Verbindung zu einem LLM (Deepseek -Modell)

11. Erstellen Sie eine Kette basierte Kette

12. Testen Sie die Lappenkette

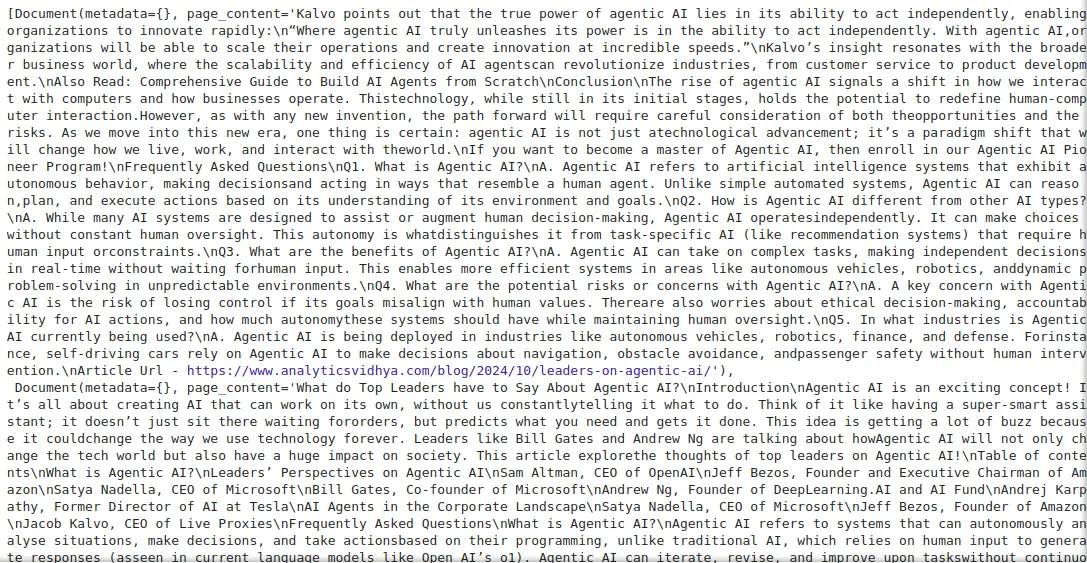

"Erz?hlen Sie den Perspektiven der Führungskr?fte auf agentische AI" ab

Code zum Erstellen eines Lappensystems mit Deepseek R1

OpenAI- und Langchain -Abh?ngigkeiten installieren curl -fsSL https://ollama.com/install.sh | sh

Geben Sie die ?ffnen von AI API -Schlüssel ein ollama pull deepseek-r1:1.5b

Umgebungsvariablen ollama pull deepseek-r1:1.5b

pulling manifest

pulling aabd4debf0c8... 100% ▕████████████████▏ 1.1 GB

pulling 369ca498f347... 100% ▕████████████████▏ 387 B

pulling 6e4c38e1172f... 100% ▕████████████████▏ 1.1 KB

pulling f4d24e9138dd... 100% ▕████████████████▏ 148 B

pulling a85fe2a2e58e... 100% ▕████████████████▏ 487 B

verifying sha256 digest

writing manifest

success

!pip install langchain==0.3.11

!pip install langchain-openai==0.2.12

!pip install langchain-community==0.3.11

!pip install langchain-chroma==0.1.4

?ffnen von AI -Einbettungsmodellen

from getpass import getpass

OPENAI_KEY = getpass('Enter Open AI API Key: ') Erstellen Sie einen Vektor -DB und bestehen auf der Festplatte

import os

os.environ['OPENAI_API_KEY'] = OPENAI_KEY

from langchain_openai import OpenAIEmbeddings

openai_embed_model = OpenAIEmbeddings(model='text-embedding-3-small')

?hnlichkeit mit Schwellenwert Abruf from langchain_community.document_loaders import PyPDFLoader

loader = PyPDFLoader('AgenticAI.pdf')

pages = loader.load_and_split()

texts = [doc.page_content for doc in pages]

from langchain_chroma import Chroma

chroma_db = Chroma.from_texts(

texts=texts,

collection_name='db_docs',

collection_metadata={"hnsw:space": "cosine"}, # Set distance function to cosine

embedding=openai_embed_model

)

similarity_threshold_retriever = chroma_db.as_retriever(search_type="similarity_score_threshold",search_kwargs={"k": 3,"score_threshold": 0.3})

query = "what is the old capital of India?"

top3_docs = similarity_threshold_retriever.invoke(query)

top3_docs

bauen Sie eine Lappenkette

[]

Verbindung zu LLM

laden

query = "What is Agentic AI?"

top3_docs = similarity_threshold_retriever.invoke(query)

top3_docs

Wie kann man Deepseek Janus Pro 7b?

zugreifen

Das obige ist der detaillierte Inhalt vonWie baue ich ein Lappensystem mit Deepseek R1?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Hei?e KI -Werkzeuge

Undress AI Tool

Ausziehbilder kostenlos

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem v?llig kostenlosen KI-Gesichtstausch-Tool aus!

Hei?er Artikel

Hei?e Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Hei?e Themen

Top 7 Notebooklm -Alternativen

Jun 17, 2025 pm 04:32 PM

Top 7 Notebooklm -Alternativen

Jun 17, 2025 pm 04:32 PM

Googles NotebookLM ist ein intelligentes KI-Notiz-Tool, das von Gemini 2.5 betrieben wird, das sich beim Zusammenfassen von Dokumenten auszeichnet. Es hat jedoch weiterhin Einschr?nkungen bei der Verwendung von Tools, wie Quellkappen, Cloud -Abh?ngigkeit und der jüngsten ?Discover“ -Funktion

Von der Adoption zum Vorteil: 10 Trends formen Enterprise LLMs im Jahr 2025

Jun 20, 2025 am 11:13 AM

Von der Adoption zum Vorteil: 10 Trends formen Enterprise LLMs im Jahr 2025

Jun 20, 2025 am 11:13 AM

Hier sind zehn überzeugende Trends, die die AI -Landschaft der Unternehmen neu ver?ndern. Das riskante finanzielle Engagement für LLMSorganisierungen erh?ht ihre Investitionen in LLM erheblich, wobei 72% erwarten, dass ihre Ausgaben in diesem Jahr steigen. Derzeit fast 40% a

KI -Investor stillte zum Stillstand? 3 Strategische Wege zum Kauf, Bau oder Partner mit KI -Anbietern

Jul 02, 2025 am 11:13 AM

KI -Investor stillte zum Stillstand? 3 Strategische Wege zum Kauf, Bau oder Partner mit KI -Anbietern

Jul 02, 2025 am 11:13 AM

Das Investieren boomt, aber Kapital allein reicht nicht aus. Mit zunehmender Bewertungen und Verblassen der Unterscheidungskraft müssen Investoren in AI-fokussierten Risikokonstrumentfonds eine wichtige Entscheidung treffen: Kaufen, Bau oder Partner, um einen Vorteil zu erlangen? Hier erfahren Sie, wie Sie jede Option bewerten - und PR

Das unaufhaltsame Wachstum der generativen KI (KI -Ausblick Teil 1)

Jun 21, 2025 am 11:11 AM

Das unaufhaltsame Wachstum der generativen KI (KI -Ausblick Teil 1)

Jun 21, 2025 am 11:11 AM

Offenlegung: Mein Unternehmen, Tirias Research, hat sich für IBM, NVIDIA und andere in diesem Artikel genannte Unternehmen beraten. Wachstumstreiber Die Anstieg der generativen KI -Adoption war dramatischer als selbst die optimistischsten Projektionen, die vorhersagen konnten. Dann a

Neuer Gallup -Bericht: KI -Kulturbereitschaft erfordert neue Denkweisen

Jun 19, 2025 am 11:16 AM

Neuer Gallup -Bericht: KI -Kulturbereitschaft erfordert neue Denkweisen

Jun 19, 2025 am 11:16 AM

Die Kluft zwischen weit verbreiteter Akzeptanz und emotionaler Bereitschaft zeigt etwas Wesentliches darüber, wie sich die Menschen mit ihrer wachsenden Auswahl an digitalen Gef?hrten besch?ftigen. Wir betreten eine Phase des Koexistenz

Diese Startups helfen Unternehmen dabei, in AI -Suchzusammenfassungen aufzutauchen

Jun 20, 2025 am 11:16 AM

Diese Startups helfen Unternehmen dabei, in AI -Suchzusammenfassungen aufzutauchen

Jun 20, 2025 am 11:16 AM

Diese Tage sind dank AI nummeriert. Suchen Sie den Verkehr für Unternehmen wie die Reisebereich Kayak und das Edtech -Unternehmen Chegg, teilweise, weil 60% der Suchanfragen auf Websites wie Google nicht dazu führen, dass Benutzer laut One Stud auf Links klicken

Agi und KI -Superintelligenz werden die Annahmesperre der menschlichen Decke stark treffen

Jul 04, 2025 am 11:10 AM

Agi und KI -Superintelligenz werden die Annahmesperre der menschlichen Decke stark treffen

Jul 04, 2025 am 11:10 AM

Reden wir darüber. Diese Analyse eines innovativen KI -Durchbruchs ist Teil meiner laufenden Forbes -S?ulenberichterstattung über die neueste in der KI, einschlie?lich der Identifizierung und Erkl?rung verschiedener wirksamer KI -Komplexit?ten (siehe Link hier). Auf dem Weg zu Agi und

Cisco zeichnet seine agierische KI -Reise bei Cisco Live US 2025 auf

Jun 19, 2025 am 11:10 AM

Cisco zeichnet seine agierische KI -Reise bei Cisco Live US 2025 auf

Jun 19, 2025 am 11:10 AM

Schauen wir uns genauer an, was ich am bedeutendsten fand - und wie Cisco auf seinen aktuellen Bemühungen aufbauen k?nnte, seine Ambitionen weiter zu verwirklichen.