base de données

base de données

tutoriel mysql

tutoriel mysql

Comprendre la technologie de partitionnement et de partitionnement de MySQL et PostgreSQL

Comprendre la technologie de partitionnement et de partitionnement de MySQL et PostgreSQL

Comprendre la technologie de partitionnement et de partitionnement de MySQL et PostgreSQL

Jul 14, 2023 pm 09:41 PMComprenez la technologie de partitionnement et de partitionnement de MySQL et PostgreSQL

Résumé?:

MySQL et PostgreSQL sont deux systèmes de gestion de bases de données relationnelles (SGBDR) courants. Ils fournissent tous deux une technologie de partitionnement et de partitionnement pour optimiser le stockage des données et l'efficacité des requêtes. Cet article présentera les concepts de base du partitionnement et du partitionnement dans MySQL et PostgreSQL, ainsi que des exemples de code pour illustrer comment utiliser ces technologies.

1. Technologie de partitionnement MySQL

- Le concept de partitionnement

La technologie de partitionnement de MySQL consiste à diviser une table en plusieurs partitions indépendantes. Chaque partition peut stocker et interroger les données indépendamment, améliorant ainsi l'efficacité des requêtes et offrant de meilleures performances. Habituellement, le partitionnement peut être effectué en fonction d'une certaine colonne du tableau (telle que la date, la région, etc.), ou les règles de partitionnement peuvent être définies via des plages, des listes, des hachages, etc. - Exemple de code pour le partitionnement

Voici un exemple de code utilisant la technologie de partitionnement de MySQL?:

Créez une table contenant les dates et les ventes?:

CREATE TABLE sales (

id INT NOT NULL AUTO_INCREMENT, date DATE, amount DECIMAL(10,2), PRIMARY KEY (id)

) ENGINE=InnoDB;

Placez la table par partition par date range?:

ALTER TABLE sales

PARTITION BY RANGE (YEAR(date))

(

PARTITION p0 VALUES LESS THAN (2010), PARTITION p1 VALUES LESS THAN (2011), PARTITION p2 VALUES LESS THAN (2012), PARTITION p3 VALUES LESS THAN (2013), PARTITION p4 VALUES LESS THAN MAXVALUE

);

Avec le code ci-dessus, la table des ventes est partitionnée en fonction de la plage de dates, et les données de chaque partition peuvent être stockées et interrogez indépendamment.

2. Technologie de partitionnement PostgreSQL

- Concept de partitionnement

La technologie de partitionnement de PostgreSQL consiste à diviser une table en plusieurs sous-tables, chaque sous-table contient une partie des données, améliorant ainsi l'efficacité des requêtes et réduisant l'utilisation de l'espace de stockage. Les règles de partitionnement peuvent être définies à l'aide de plages, de listes, de hachages, etc., et chaque sous-table peut stocker et interroger des données indépendamment. - Exemple de code pour le partitionnement

Voici un exemple de code utilisant la technologie de partitionnement de PostgreSQL?:

Créez une table contenant les dates et les ventes?:

CREATE TABLE sales (

id SERIAL, date DATE, amount DECIMAL(10,2), PRIMARY KEY (id)

);

Créez une table parent et définissez des règles de partition?:

CREATE TABLE sales_partition (

date_range TSRANGE, CHECK (date_range IS NOT NULL)

) PARTITION BY RANGE (date_range);

Créez deux sous-tables?:

CREATE TABLE sales_jan2018 PARTITION OF sales_partition

FOR VALUES FROM ('2018-01-01', '2018-02-01');

CREATE TABLE sales_feb2018 PARTITION OF sales_partition

FOR VALUES FROM ('2018-02-01', '2018-03-01');

Avec le code ci-dessus, créez A table parent sales_partition et deux tables enfants sales_jan2018 et sales_feb2018 sont créées. Chaque table enfant contient des données dans la plage de dates spécifiée.

Conclusion?:?

MySQL et PostgreSQL fournissent tous deux une technologie de partitionnement et de partitionnement pour aider à optimiser le stockage des données et l'efficacité des requêtes. En utilisant ces techniques, vous pouvez obtenir de meilleures performances et une meilleure évolutivité lors du traitement de grandes quantités de données. Cependant, il est nécessaire de sélectionner des stratégies de partitionnement et de partitionnement appropriées en fonction des besoins et des scénarios métier spécifiques, et de concevoir et gérer raisonnablement la structure de partitionnement/partitionnement.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undress AI Tool

Images de déshabillage gratuites

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Clothoff.io

Dissolvant de vêtements AI

Video Face Swap

échangez les visages dans n'importe quelle vidéo sans effort grace à notre outil d'échange de visage AI entièrement gratuit?!

Article chaud

Outils chauds

Bloc-notes++7.3.1

éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

DualBEV?: dépassant largement BEVFormer et BEVDet4D, ouvrez le livre?!

Mar 21, 2024 pm 05:21 PM

DualBEV?: dépassant largement BEVFormer et BEVDet4D, ouvrez le livre?!

Mar 21, 2024 pm 05:21 PM

Cet article explore le problème de la détection précise d'objets sous différents angles de vue (tels que la perspective et la vue à vol d'oiseau) dans la conduite autonome, en particulier comment transformer efficacement les caractéristiques de l'espace en perspective (PV) en vue à vol d'oiseau (BEV). implémenté via le module Visual Transformation (VT). Les méthodes existantes sont globalement divisées en deux stratégies?: la conversion 2D en 3D et la conversion 3D en 2D. Les méthodes 2D vers 3D améliorent les caractéristiques 2D denses en prédisant les probabilités de profondeur, mais l'incertitude inhérente aux prévisions de profondeur, en particulier dans les régions éloignées, peut introduire des inexactitudes. Alors que les méthodes 3D vers 2D utilisent généralement des requêtes 3D pour échantillonner des fonctionnalités 2D et apprendre les poids d'attention de la correspondance entre les fonctionnalités 3D et 2D via un transformateur, ce qui augmente le temps de calcul et de déploiement.

Avez-vous vraiment ma?trisé la conversion des systèmes de coordonnées?? Des enjeux multi-capteurs indispensables à la conduite autonome

Oct 12, 2023 am 11:21 AM

Avez-vous vraiment ma?trisé la conversion des systèmes de coordonnées?? Des enjeux multi-capteurs indispensables à la conduite autonome

Oct 12, 2023 am 11:21 AM

Le premier article pilote et clé présente principalement plusieurs systèmes de coordonnées couramment utilisés dans la technologie de conduite autonome, et comment compléter la corrélation et la conversion entre eux, et enfin construire un modèle d'environnement unifié. L'objectif ici est de comprendre la conversion du véhicule en corps rigide de caméra (paramètres externes), la conversion de caméra en image (paramètres internes) et la conversion d'image en unité de pixel. La conversion de 3D en 2D aura une distorsion, une traduction, etc. Points clés : Le système de coordonnées du véhicule et le système de coordonnées du corps de la caméra doivent être réécrits : le système de coordonnées planes et le système de coordonnées des pixels Difficulté : la distorsion de l'image doit être prise en compte. La dé-distorsion et l'ajout de distorsion sont compensés sur le plan de l'image. 2. Introduction Il existe quatre systèmes de vision au total : système de coordonnées du plan de pixels (u, v), système de coordonnées d'image (x, y), système de coordonnées de caméra () et système de coordonnées mondiales (). Il existe une relation entre chaque système de coordonnées,

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il ??y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

La prédiction de trajectoire joue un r?le important dans la conduite autonome. La prédiction de trajectoire de conduite autonome fait référence à la prédiction de la trajectoire de conduite future du véhicule en analysant diverses données pendant le processus de conduite du véhicule. En tant que module central de la conduite autonome, la qualité de la prédiction de trajectoire est cruciale pour le contr?le de la planification en aval. La tache de prédiction de trajectoire dispose d'une riche pile technologique et nécessite une connaissance de la perception dynamique/statique de la conduite autonome, des cartes de haute précision, des lignes de voie, des compétences en architecture de réseau neuronal (CNN&GNN&Transformer), etc. Il est très difficile de démarrer?! De nombreux fans espèrent se lancer dans la prédiction de trajectoire le plus t?t possible et éviter les pièges. Aujourd'hui, je vais faire le point sur quelques problèmes courants et des méthodes d'apprentissage introductives pour la prédiction de trajectoire ! Connaissances introductives 1. Existe-t-il un ordre d'entrée pour les épreuves de prévisualisation ? R?: Regardez d’abord l’enquête, p

Revoir! Fusion profonde de modèles (LLM/modèle de base/apprentissage fédéré/mise au point, etc.)

Apr 18, 2024 pm 09:43 PM

Revoir! Fusion profonde de modèles (LLM/modèle de base/apprentissage fédéré/mise au point, etc.)

Apr 18, 2024 pm 09:43 PM

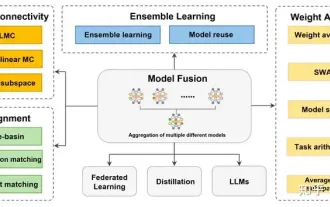

Le 23 septembre, l'article ? DeepModelFusion:ASurvey ? a été publié par l'Université nationale de technologie de la défense, JD.com et l'Institut de technologie de Pékin. La fusion/fusion de modèles profonds est une technologie émergente qui combine les paramètres ou les prédictions de plusieurs modèles d'apprentissage profond en un seul modèle. Il combine les capacités de différents modèles pour compenser les biais et les erreurs des modèles individuels pour de meilleures performances. La fusion profonde de modèles sur des modèles d'apprentissage profond à grande échelle (tels que le LLM et les modèles de base) est confrontée à certains défis, notamment un co?t de calcul élevé, un espace de paramètres de grande dimension, l'interférence entre différents modèles hétérogènes, etc. Cet article divise les méthodes de fusion de modèles profonds existantes en quatre catégories?: (1) ??Connexion de modèles??, qui relie les solutions dans l'espace de poids via un chemin de réduction des pertes pour obtenir une meilleure fusion de modèles initiale.

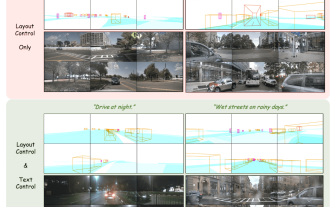

Le premier modèle mondial de génération de vidéos de scènes de conduite autonomes multi-vues DrivingDiffusion?: nouvelles idées pour les données et la simulation BEV

Oct 23, 2023 am 11:13 AM

Le premier modèle mondial de génération de vidéos de scènes de conduite autonomes multi-vues DrivingDiffusion?: nouvelles idées pour les données et la simulation BEV

Oct 23, 2023 am 11:13 AM

Quelques réflexions personnelles de l'auteur Dans le domaine de la conduite autonome, avec le développement de sous-taches/solutions de bout en bout basées sur BEV, les données d'entra?nement multi-vues de haute qualité et la construction de scènes de simulation correspondantes sont devenues de plus en plus importantes. En réponse aux problèmes des taches actuelles, la ??haute qualité?? peut être divisée en trois aspects?: des scénarios à longue tra?ne dans différentes dimensions?: comme les véhicules à courte portée dans les données sur les obstacles et les angles de cap précis lors du découpage des voitures, et les données sur les lignes de voie. . Scènes telles que des courbes avec des courbures différentes ou des rampes/fusions/fusions difficiles à capturer. Celles-ci reposent souvent sur de grandes quantités de données collectées et sur des stratégies complexes d’exploration de données, qui sont co?teuses. Valeur réelle 3D - image hautement cohérente?: l'acquisition actuelle des données BEV est souvent affectée par des erreurs d'installation/calibrage du capteur, des cartes de haute précision et l'algorithme de reconstruction lui-même. cela m'a amené à

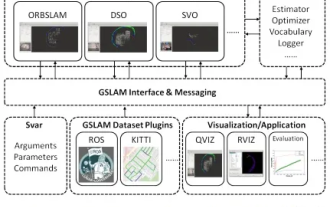

GSLAM | Une architecture générale et un benchmark

Oct 20, 2023 am 11:37 AM

GSLAM | Une architecture générale et un benchmark

Oct 20, 2023 am 11:37 AM

J'ai soudainement découvert un article vieux de 19 ans GSLAM : A General SLAM Framework and Benchmark open source code : https://github.com/zdzhaoyong/GSLAM Accédez directement au texte intégral et ressentez la qualité de ce travail ~ 1 Technologie SLAM abstraite a remporté de nombreux succès récemment et a attiré de nombreuses entreprises de haute technologie. Cependant, la question de savoir comment s'interfacer avec les algorithmes existants ou émergents pour effectuer efficacement des analyses comparatives en termes de vitesse, de robustesse et de portabilité reste une question. Dans cet article, une nouvelle plateforme SLAM appelée GSLAM est proposée, qui fournit non seulement des capacités d'évaluation, mais fournit également aux chercheurs un moyen utile de développer rapidement leurs propres systèmes SLAM.

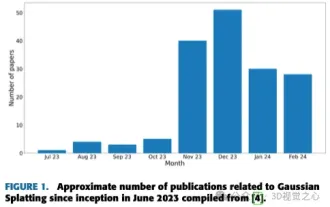

Plus qu'une simple gaussienne 3D?! Dernier aper?u des techniques de reconstruction 3D de pointe

Jun 02, 2024 pm 06:57 PM

Plus qu'une simple gaussienne 3D?! Dernier aper?u des techniques de reconstruction 3D de pointe

Jun 02, 2024 pm 06:57 PM

écrit ci-dessus & La compréhension personnelle de l'auteur est que la reconstruction 3D basée sur l'image est une tache difficile qui implique de déduire la forme 3D d'un objet ou d'une scène à partir d'un ensemble d'images d'entrée. Les méthodes basées sur l’apprentissage ont attiré l’attention pour leur capacité à estimer directement des formes 3D. Cet article de synthèse se concentre sur les techniques de reconstruction 3D de pointe, notamment la génération de nouvelles vues inédites. Un aper?u des développements récents dans les méthodes d'éclaboussure gaussienne est fourni, y compris les types d'entrée, les structures de modèle, les représentations de sortie et les stratégies de formation. Les défis non résolus et les orientations futures sont également discutés. Compte tenu des progrès rapides dans ce domaine et des nombreuses opportunités d’améliorer les méthodes de reconstruction 3D, un examen approfondi de l’algorithme semble crucial. Par conséquent, cette étude fournit un aper?u complet des progrès récents en matière de diffusion gaussienne. (Faites glisser votre pouce vers le haut