DeepGemm Dikeluarkan pada Hari 3 Minggu Sumber Terbuka DeepSeek

Mar 03, 2025 pm 06:58 PMDeepSeek melepaskan DeepGemm: Perpustakaan FP8 Gemm berprestasi tinggi untuk AI

Sebagai sebahagian daripada #OpensourceWeek, DeepSeek melancarkan DeepGemm, perpustakaan canggih yang dioptimumkan untuk pendaraban matriks umum FP8 yang cekap (GEMM). Perpustakaan ini menyokong kedua-dua GEMM yang padat dan campuran (MOE), membuktikan tidak ternilai untuk latihan dan kesimpulan model V3/R1. DeepGEMM bertujuan untuk meningkatkan prestasi dan kecekapan dalam beban kerja AI dengan ketara, memperkuat komitmen DeepSeek untuk inovasi sumber terbuka.

? Hari 3 dari #OpensourceWeek: DeepGemm

Memperkenalkan DeepGEMM - Perpustakaan FP8 GEMM yang menyokong padat dan MOE GEMM, memanfaatkan latihan dan kesimpulan V3/R1.

? hingga 1350 fp8 tflops pada gpus hopper

? Ketergantungan minimum, direka untuk kemudahan penggunaan

? sepenuhnya dalam masa yang disusun ...- DeepSeek (@deepseek_ai) 26 Februari, 2025

Siaran ini mengikuti pelancaran kejayaan DeepSeek FlashML (Hari 1) dan DeepSeek Deepep (Hari 2).

Jadual Kandungan

- Apa itu Gemm?

- Apa itu fp8?

- Keperluan untuk DeepGemm

- Ciri -ciri utama DeepGemm

- Penanda aras prestasi

- Arahan Pemasangan

- Kesimpulan

Apa itu Gemm?

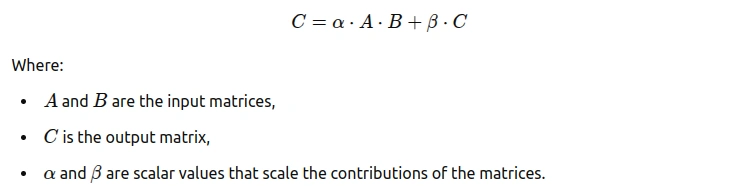

Pendaraban Matriks Umum (GEMM) adalah operasi algebra linear asas mengalikan dua matriks untuk menghasilkan satu pertiga. Digunakan secara meluas dalam pelbagai aplikasi, formulanya ialah:

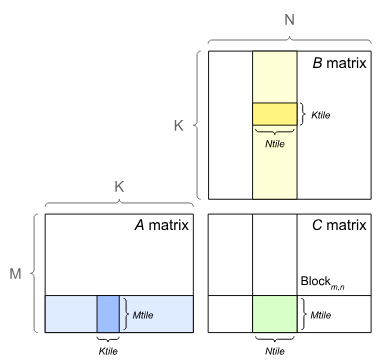

Ilustrasi ini menunjukkan GEMM, menonjolkan jubin (membahagikan matriks ke blok yang lebih kecil - mtile, ntile, ktile) untuk penggunaan cache yang dioptimumkan. Ini meningkatkan prestasi melalui kawasan data dan paralelisme yang dipertingkatkan.

Ilustrasi ini menunjukkan GEMM, menonjolkan jubin (membahagikan matriks ke blok yang lebih kecil - mtile, ntile, ktile) untuk penggunaan cache yang dioptimumkan. Ini meningkatkan prestasi melalui kawasan data dan paralelisme yang dipertingkatkan.

Apa itu fp8?

FP8 (8-bit floating-point) adalah format pengkomputeran berprestasi tinggi yang menawarkan ketepatan yang dikurangkan dan perwakilan data berangka yang cekap. Ia amat bermanfaat untuk mengendalikan tuntutan pengiraan dataset besar dalam pembelajaran mesin.

Format FP8 biasa termasuk:

1 tanda bit

- 5 bit eksponen

- 2 pecahan bit

- Struktur padat ini membolehkan pengiraan yang lebih cepat dan mengurangkan penggunaan memori, sesuai untuk melatih model besar. Walaupun ketepatan mungkin sedikit dikompromi, ini sering diterima, bahkan membawa kepada keuntungan prestasi akibat pengurangan overhead pengiraan.

Imej ini membandingkan FP8 (format E4M3 dan E5M2) dengan FP16 dan BF16, yang menggambarkan perdagangan antara ketepatan dan julat untuk format terapung yang berbeza.

Keperluan untuk DeepGemm

DeepGEMM menangani cabaran pendaraban matriks dengan menawarkan perpustakaan ringan, berprestasi tinggi, dan mesra pengguna untuk operasi GEMM yang pelbagai.

- memenuhi keperluan kritikal untuk FP8 GEMM yang dioptimumkan dalam komuniti AI.

- prestasi tinggi dengan jejak memori kecil.

- menyokong kedua -dua susun atur padat dan MOE.

- penting untuk latihan dan pelaksanaan model AI berskala besar.

- Mengoptimumkan seni bina MOE dengan jenis GEMM khusus.

- secara langsung meningkatkan model AI DeepSeek.

- memberi manfaat kepada ekosistem pembangunan AI yang lebih luas.

Kekuatan DeepGemm termasuk:

- Prestasi tinggi:

- mencapai sehingga 1350 fp8 tflops pada GPU NVIDIA HOPPER. Reka bentuk ringan:

- kebergantungan minimum untuk penggunaan mudah. ?? kompilasi tepat masa:

- menyusun kernel pada runtime untuk pengalaman pengguna yang diselaraskan. Logik teras ringkas:

- Kira-kira 300 baris kod teras, mengatasi banyak biji-bijian yang ditunaikan oleh pakar. Sokongan untuk susun atur yang pelbagai:

- menyokong susun atur padat dan dua moe.

Kecekapan DeepGemM merentasi pelbagai konfigurasi matriks ditunjukkan di bawah:

3 /gaya tersuai untuk jadual

/ .custom-table { Lebar: 100%; Sempadan-keruntuhan: runtuh; /memastikan sempadan tidak menggandakan / Margin: 20px 0; } .Custom-table th, .Custom-table TD { Sempadan: 1px pepejal #000; / sempadan yang kelihatan / Padding: 12px; / padding selesa

Jadual 1: Penanda aras prestasi DeepGemm

Arahan pemasangan

Pemasangan DeepGemm adalah mudah:

Langkah 1: Prasyarat

- Hopper Architecture GPU (SM_90A)

- python 3.8

- CUDA 12.3 (disyorkan: 12.8)

- Pytorch 2.1

- cutlass 3.6 (boleh menjadi submodule git)

Langkah 2: klon repositori

git clone --recursive [email?protected]:deepseek-ai/DeepGEMM.git

Langkah 3: Pasang perpustakaan

python setup.py install

Langkah 4: Import DeepGemm

import deep_gemm

Lihat repositori DeepGemm GitHub untuk arahan terperinci.

Kesimpulan

DeepGEMM adalah perpustakaan FP8 GEMM yang berprestasi tinggi, mesra pengguna yang sesuai untuk tugas pembelajaran mesin lanjutan. Reka bentuk, kelajuan, dan fleksibiliti ringan menjadikannya alat yang berharga untuk pemaju AI. Semak blog Analytics Vidhya untuk kemas kini mengenai pelepasan Hari 4 DeepSeek!

Atas ialah kandungan terperinci DeepGemm Dikeluarkan pada Hari 3 Minggu Sumber Terbuka DeepSeek. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undress AI Tool

Gambar buka pakaian secara percuma

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Alternatif Notebooklm Top 7 Top

Jun 17, 2025 pm 04:32 PM

Alternatif Notebooklm Top 7 Top

Jun 17, 2025 pm 04:32 PM

NotebookLM Google adalah alat pengambilan nota AI pintar yang dikuasakan oleh Gemini 2.5, yang cemerlang dalam meringkaskan dokumen. Walau bagaimanapun, ia masih mempunyai batasan penggunaan alat, seperti topi sumber, pergantungan awan, dan ciri "Discover" baru -baru ini

Dari Adopsi ke Kelebihan: 10 Trend Membentuk LLMS Enterprise pada tahun 2025

Jun 20, 2025 am 11:13 AM

Dari Adopsi ke Kelebihan: 10 Trend Membentuk LLMS Enterprise pada tahun 2025

Jun 20, 2025 am 11:13 AM

Berikut adalah sepuluh trend yang menarik yang membentuk semula landskap AI perusahaan. Komitmen kewangan untuk llmsorganizations secara signifikan meningkatkan pelaburan mereka di LLM, dengan 72% menjangkakan perbelanjaan mereka meningkat tahun ini. Pada masa ini, hampir 40% a

Pelabur AI terjebak dengan terhenti? 3 Laluan Strategik untuk Membeli, Membina, atau Berkongsi dengan Vendor AI

Jul 02, 2025 am 11:13 AM

Pelabur AI terjebak dengan terhenti? 3 Laluan Strategik untuk Membeli, Membina, atau Berkongsi dengan Vendor AI

Jul 02, 2025 am 11:13 AM

Pelaburan adalah berkembang pesat, tetapi modal sahaja tidak mencukupi. Dengan penilaian yang semakin meningkat dan tersendiri pudar, pelabur dalam dana usaha yang berfokus pada AI mesti membuat keputusan utama: Beli, membina, atau rakan kongsi untuk mendapatkan kelebihan? Inilah cara menilai setiap pilihan dan PR

Pertumbuhan AI generatif yang tidak boleh dihalang (AI Outlook Bahagian 1)

Jun 21, 2025 am 11:11 AM

Pertumbuhan AI generatif yang tidak boleh dihalang (AI Outlook Bahagian 1)

Jun 21, 2025 am 11:11 AM

Pendedahan: Syarikat saya, Tirias Research, telah berunding untuk IBM, NVIDIA, dan syarikat -syarikat lain yang disebutkan dalam artikel ini. Pemandu Growth Surge dalam penggunaan AI generatif lebih dramatik daripada unjuran yang paling optimis dapat diramalkan. Kemudian, a

Laporan Gallup Baru: Kesediaan Kebudayaan AI Menuntut Mindset Baru

Jun 19, 2025 am 11:16 AM

Laporan Gallup Baru: Kesediaan Kebudayaan AI Menuntut Mindset Baru

Jun 19, 2025 am 11:16 AM

Jurang antara penggunaan yang meluas dan kesediaan emosi mendedahkan sesuatu yang penting tentang bagaimana manusia terlibat dengan pelbagai sahabat digital mereka. Kami memasuki fasa kewujudan bersama di mana algoritma menenun ke dalam harian kami

Permulaan ini membantu perniagaan muncul dalam ringkasan carian AI

Jun 20, 2025 am 11:16 AM

Permulaan ini membantu perniagaan muncul dalam ringkasan carian AI

Jun 20, 2025 am 11:16 AM

Hari -hari itu bernombor, terima kasih kepada AI. Cari lalu lintas untuk perniagaan seperti tapak perjalanan kayak dan syarikat edtech Chegg menurun, sebahagiannya kerana 60% carian di laman web seperti Google tidak mengakibatkan pengguna mengklik sebarang pautan, menurut satu stud

AGI dan AI Superintelligence akan dengan ketara memukul penghalang asumsi siling manusia

Jul 04, 2025 am 11:10 AM

AGI dan AI Superintelligence akan dengan ketara memukul penghalang asumsi siling manusia

Jul 04, 2025 am 11:10 AM

Mari kita bercakap mengenainya. Analisis terobosan AI yang inovatif ini adalah sebahagian daripada liputan lajur Forbes yang berterusan pada AI terkini, termasuk mengenal pasti dan menerangkan pelbagai kerumitan AI yang memberi kesan (lihat pautan di sini). Menuju ke Agi dan

Cisco mencatatkan perjalanan AI yang agentik di Cisco Live A.S. 2025

Jun 19, 2025 am 11:10 AM

Cisco mencatatkan perjalanan AI yang agentik di Cisco Live A.S. 2025

Jun 19, 2025 am 11:10 AM

Mari kita lihat dengan lebih dekat apa yang saya dapati paling penting - dan bagaimana Cisco dapat membina usaha semasa untuk merealisasikan cita -citanya. (Nota: Cisco adalah pelanggan penasihat firma saya, Moor Insights & Strategy.) Berfokus pada AIS dan CU Agentik dan CU